Cosa sono i modelli linguistici di grandi dimensioni (LLM)?

I grandi modelli linguistici (LLM) sono uno sviluppo all'avanguardia dell'elaborazione del linguaggio naturale (NLP), progettato per comprendere e generare il linguaggio umano. Gli LLM sono modelli avanzati di intelligenza artificiale addestrati su grandi quantità di dati testuali, che consentono loro di riconoscere i modelli linguistici, comprendere il contesto e produrre risposte coerenti e contestualmente rilevanti. Mentre l'NLP fornisce le tecniche fondamentali per le macchine che si cimentano con il linguaggio, le LLM rappresentano un approccio specializzato che ha migliorato in modo significativo la capacità delle macchine di imitare la comprensione del linguaggio umano e la generazione...

Quali sono gli attuali LLM?

I LLM rappresentano la frontiera dell'elaborazione del linguaggio naturale e diversi modelli dominano attualmente lo spazio, tra cui Gemini di Google, Galactica e Llama di Meta, la serie GPT di OpenAI e altri come Falcon 40B e Phi-1. Con diverse architetture e dimensioni dei parametri, questi modelli eccellono in compiti che vanno dalla risposta alle query alla generazione di testi coerenti e contestualmente rilevanti su lunghi passaggi.

BERT, introdotto da Google, ha gettato le basi fondamentali con la sua architettura basata su trasformatori. D'altra parte, Meta's Galactica, un concorrente recente, si rivolge esplicitamente alla comunità scientifica, mentre affronta l'esame per la produzione di "allucinazioni" fuorvianti che potrebbero avere profonde implicazioni nel campo scientifico. Nel frattempo, la serie GPT di OpenAI, in particolare GPT-3 e GPT-4, è stata rivoluzionaria nelle sue capacità, con quest'ultima che si dice contenga oltre 170 mila miliardi di parametri e sia in grado di elaborare sia testo che immagini. L'abilità di questo modello ha portato a speculazioni sull'approssimarsi dell'intelligenza artificiale generale (AGI), una capacità teorica della macchina pari o superiore all'intelligenza umana.

Le sfide, tuttavia, persistono. L'enorme scala e complessità di questi modelli può portare a risultati imprevedibili, e i loro immensi requisiti di formazione sollevano preoccupazioni sulla sostenibilità ambientale e sui risultati distorti.

Nonostante le preoccupazioni, però, l'evoluzione degli LLM promette progressi in diversi settori, da attività banali come il miglioramento della ricerca sul web ad aree critiche come la ricerca medica e la sicurezza informatica. Con l'avanzamento del campo, l'equilibrio tra potenziale e cautela rimane fondamentale.

Come funzionano gli LLM

Per eccellere nella comprensione e nella generazione di un linguaggio simile a quello umano, gli LLM utilizzano una combinazione di reti neurali, vasti set di dati di formazione e un'architettura chiamata trasformatori.

Reti neurali

Al centro dei modelli linguistici di grandi dimensioni ci sono le reti neurali con più strati, note come modelli di apprendimento profondo. Queste reti sono costituite da nodi interconnessi, o neuroni, che imparano a riconoscere i modelli nei dati di ingresso durante la fase di addestramento. I LLM vengono addestrati su un'enorme quantità di testo, che comprende fonti diverse come siti web, libri e articoli, consentendo loro di apprendere la grammatica, la sintassi, la semantica e le informazioni contestuali.

Sulla base di algoritmi progettati per riconoscere i modelli, le reti neurali interpretano i dati sensoriali attraverso una sorta di percezione della macchina, etichettando o raggruppando gli input grezzi. Le architetture delle reti neurali vanno dalle semplici reti feedforward, in cui le connessioni tra i nodi non formano un ciclo, a strutture complesse con strati sofisticati e cicli di feedback multipli.

Reti neurali evolutive (CNN): Sono particolarmente efficaci per l'elaborazione dei dati con una topologia a griglia. Gli esempi includono i dati delle immagini, che possono essere considerati come una griglia 2D di pixel.

Reti neurali ricorrenti (RNN): Sono adatti per i dati sequenziali come il testo e il parlato. L'output in ogni fase dipende dai calcoli precedenti e da un certo tipo di memoria su ciò che è stato elaborato finora.

Trasformatori

L'architettura del trasformatore è un componente critico degli LLM, introdotto da Vaswani et al. nel 2017. I trasformatori affrontano i limiti dei modelli di sequenza precedenti, come le RNN e le LSTM, che avevano difficoltà con le dipendenze a lungo raggio e la parallelizzazione. I trasformatori impiegano un meccanismo chiamato auto-attenzione, che consente al modello di pesare l'importanza di diverse parole nel contesto di ingresso e di cogliere le relazioni tra di esse, indipendentemente dalla loro distanza nella sequenza.

Tokenizzazione

La tokenizzazione è il primo passo nell'elaborazione del testo con un LLM. Il testo in ingresso viene suddiviso in unità più piccole chiamate tokens, che vengono poi convertite in rappresentazioni numeriche (vettori) che la rete neurale può elaborare. Durante l'addestramento, il modello impara a generare token di output contestualmente appropriati, in base ai token di input e alle loro relazioni.

Il processo di addestramento prevede la regolazione dei pesi delle connessioni della rete neurale attraverso una tecnica chiamata backpropagation. Minimizzando la differenza tra le previsioni del modello e i token target effettivi nei dati di formazione, il modello impara a generare un linguaggio più preciso e coerente.

Una volta addestrati, i modelli linguistici di grandi dimensioni possono essere perfezionati su compiti o domini specifici, come l'analisi del sentimento, la sintesi o la risposta alle domande, addestrando il modello per un breve periodo su un set di dati più piccolo, specifico per il compito. Questo processo consente all'LLM di adattare la sua comprensione linguistica generalizzata alle sfumature e ai requisiti del compito target.

Articolo correlato: L'intelligenza artificiale spiegata

Vantaggi degli LLM

I modelli linguistici di grandi dimensioni offrono un'ampia gamma di vantaggi, tra cui:

- Comprensione avanzata del linguaggio naturale: I LLM possono comprendere il contesto e le sfumature del linguaggio, rendendo le loro risposte più pertinenti e simili a quelle umane.

- Versatilità: Gli LLM possono essere applicati a diversi compiti, come la generazione di testi, la sintesi, la traduzione e la risposta alle domande, senza richiedere una formazione specifica per il compito.

- Traduzione: I LLM formati in più lingue possono tradurre efficacemente tra di esse. Alcuni ipotizzano che potrebbero persino ricavare significati da lingue sconosciute o perdute, basandosi sui modelli.

- Automatizzare le attività banali: I LLM possono svolgere compiti legati al testo come riassumere, riformulare e generare contenuti, il che può essere particolarmente utile per le aziende e i creatori di contenuti.

- Abilità emergenti: Grazie alla grande quantità di dati su cui vengono addestrati, gli LLM possono mostrare capacità inaspettate ma impressionanti, come l'aritmetica in più fasi, la risposta a domande complesse e la generazione di suggerimenti a catena di pensiero.

- Debug e codifica: Nella cybersecurity, gli LLM possono aiutare a scrivere e a eseguire il debug del codice in modo più rapido rispetto ai metodi tradizionali.

- Analisi dei modelli di minaccia: Nella cybersecurity, gli LLM possono identificare i modelli relativi alle minacce persistenti avanzate, aiutando l'attribuzione degli incidenti e la mitigazione in tempo reale.

- Automazione della risposta: Nei Security Operations Center, gli LLM possono automatizzare le risposte, generare script e strumenti e assistere nella stesura dei rapporti, riducendo il tempo che i professionisti della sicurezza dedicano alle attività di routine.

Nonostante questi vantaggi, è essenziale ricordare che gli LLM hanno degli svantaggi e delle considerazioni etiche che devono essere gestite.

Sfide con gli LLM

Sebbene sia facile lasciarsi coinvolgere dai vantaggi offerti dalle impressionanti capacità linguistiche di un LLM, le organizzazioni devono anche essere consapevoli e preparate ad affrontare le potenziali sfide che ne derivano.

Sfide operative

- Allucinazione: Gli LLM possono talvolta produrre output bizzarri e non veritieri o dare l'impressione di essere senzienti. Questi risultati non si basano sui dati di formazione del modello e sono definiti "allucinazioni".

- Pregiudizio: Se un LLM viene addestrato su dati distorti, i suoi risultati possono essere discriminatori o distorti nei confronti di determinati gruppi, razze o classi. Anche dopo l'addestramento, i pregiudizi possono evolvere in base alle interazioni dell'utente. Tay di Microsoft è un noto esempio di come i pregiudizi possano manifestarsi e aggravarsi.

- Gettoni glitch o esempi avversariali: Si tratta di input specifici creati per far sì che il modello produca risultati errati o fuorvianti, causando di fatto un "malfunzionamento" del modello.

- Mancanza di spiegabilità: Può essere difficile capire come gli LLM prendano determinate decisioni o generino output specifici, rendendo difficile la risoluzione dei problemi o il loro perfezionamento.

- L'eccessiva fiducia: Con l'integrazione dei corsi di laurea in vari settori, c'è il rischio di un'eccessiva dipendenza, che potrebbe mettere in secondo piano l'esperienza e l'intuizione umana.

Casi d'uso di LLM e opzioni di distribuzione.

Gli LLM offrono alle organizzazioni una serie di modelli di implementazione opzionali, ognuno dei quali si basa su una serie diversa di strumenti e sulle relative implicazioni di sicurezza.

Uso di LLM pre-addestrati

I provider cloud come OpenAI e Anthropic offrono l'accesso API a potenti LLM che gestiscono e proteggono. Le organizzazioni possono sfruttare queste API per incorporare le funzionalità LLM nelle loro applicazioni senza dover gestire l'infrastruttura sottostante.

In alternativa, i LLM open-source, come LLaMa di Meta, possono essere eseguiti sull'infrastruttura di un'organizzazione, offrendo un maggiore controllo e opzioni di personalizzazione. Per quanto riguarda gli aspetti negativi, gli LLM open-source richiedono risorse di calcolo significative e competenze di intelligenza artificiale per essere implementati e mantenuti in modo sicuro.

I modelli di distribuzione degli LLMs...

- SaaaS basato su API: L'infrastruttura è fornita e gestita dallo sviluppatore di LLM (ad esempio, OpenAI) e il provisioning avviene tramite un'API pubblica.

- CSP gestito: L'LLM viene distribuito su infrastrutture fornite da hyperscaler cloud e può essere eseguito in un cloud privato o pubblico, come Azure, OpenAI e Amazon Bedrock.

- Autogestito: L'LLM viene distribuito sull'infrastruttura dell'azienda, il che è rilevante solo per i modelli open-source o homegrown.

Gli LLM pre-addestrati offrono diverse funzionalità: generazione di contenuti, chatbot, analisi del sentimento, traduzione linguistica e assistenti al codice. Un'azienda di e-commerce potrebbe utilizzare un LLM per generare descrizioni di prodotti, mentre un'azienda di sviluppo software potrebbe sfruttare un assistente di codifica alimentato da LLM per aumentare la produttività dei programmatori.

Implicazioni per la sicurezza associate a LLM pre-addestrati

La disponibilità di API cloud facilmente accessibili e di modelli open-source ha abbassato drasticamente le barriere all'aggiunta di capacità linguistiche AI avanzate alle applicazioni. Gli sviluppatori possono ora inserire gli LLM nel loro software senza dover mantenere una profonda competenza in materia di AI e ML. Se da un lato questo accelera l'innovazione, dall'altro aumenta il rischio di progetti di AI ombra che non hanno un'adeguata supervisione della sicurezza e della conformità. I team di sviluppo, nel frattempo, potrebbero sperimentare gli LLM senza considerare appieno la privacy dei dati, la gestione del modelloe i problemi di controllo dell'output.

Messa a punto e Generazione Aumentata del Recupero (RAG)

Per personalizzare gli LLM per applicazioni specifiche, le organizzazioni possono metterli a punto su insiemi di dati più piccoli relativi al compito desiderato o implementare la RAG, che prevede l'integrazione degli LLM con le basi di conoscenza per la risposta alle domande e la sintesi dei contenuti.

I casi d'uso per questi includono assistenti AI specializzati con accesso ai dati interni (ad esempio, per l'assistenza clienti, le risorse umane o l'helpdesk IT) e app Q&A (ad esempio, per la documentazione, i repository di codice o i materiali di formazione). Ad esempio, il chatbot del servizio clienti di un'azienda di telecomunicazioni potrebbe essere perfezionato sulla base della documentazione del prodotto, delle FAQ o delle interazioni di assistenza passate, per assistere meglio i clienti nelle questioni tecniche e nella gestione dell'account.

Implicazioni per la sicurezza associate alla messa a punto e al RAG

La messa a punto e il RAG consentono alle organizzazioni di adattare gli LLM al loro dominio e ai loro dati specifici, permettendo di ottenere risultati più mirati e accurati. Tuttavia, questo processo di personalizzazione spesso comporta l'esposizione del modello a informazioni interne sensibili durante la formazione. Sono necessarie solide pratiche di governance dei dati per garantire che solo i dati autorizzati vengano utilizzati per la messa a punto e che i modelli risultanti siano protetti.

Modello di formazione

Alcune grandi aziende tecnologiche e istituti di ricerca scelgono di investire nella formazione dei propri LLM. Sebbene si tratti di un processo ad alta intensità di risorse che richiede una potenza di calcolo e set di dati massicci, offre alle organizzazioni il pieno controllo sull'architettura del modello, sui dati di formazione e sul processo di ottimizzazione. Inoltre, l'organizzazione mantiene i diritti di proprietà intellettuale sui modelli risultanti.

La formazione dei modelli può portare ad applicazioni avanzate come la scoperta di farmaci, la scienza dei materiali o i sistemi autonomi. Un'organizzazione sanitaria potrebbe sviluppare un modello per aiutare a diagnosticare le malattie a partire dalle cartelle cliniche e dai dati di imaging, per esempio.

Implicazioni per la sicurezza associate alla formazione dei modelli

La formazione di LLM personalizzati solleva questioni difficili su come mantenere la responsabilità e la verificabilità del comportamento del modello quando si tratta di modelli black-box complessi. Il processo di addestramento stesso consuma enormi risorse di calcolo, richiedendo un forte isolamento e controlli di accesso intorno all'ambiente di addestramento per evitare abusi o interferenze. In primo luogo, l'organizzazione deve costruire un'infrastruttura di calcolo ad alte prestazioni e curare con attenzione gli enormi set di dati, il che può introdurre nuove sfide di sicurezza.

LLM Preoccupazioni per la sicurezza

Una delle preoccupazioni principali nella distribuzione di modelli linguistici di grandi dimensioni in ambito aziendale è la potenziale inclusione di dati sensibili durante l'addestramento. Una volta che i dati sono stati incorporati in questi modelli, diventa difficile discernere con precisione quali informazioni sono state inserite. Questa mancanza di visibilità può essere problematica se si considera la miriade di fonti di dati utilizzate per la formazione e le varie persone che potrebbero accedere a questi dati.

Garantire la visibilità delle fonti di dati e mantenere un controllo rigoroso su chi vi ha accesso è fondamentale per evitare l'esposizione involontaria di informazioni riservate.

Un'ulteriore preoccupazione è il potenziale uso improprio degli LLM negli attacchi informatici. Gli attori malintenzionati possono utilizzare gli LLM per creare e-mail di phishing persuasive per ingannare le persone e ottenere un accesso non autorizzato a dati sensibili. Questo metodo, noto come social engineering, ha il potenziale di creare contenuti convincenti e ingannevoli, aumentando le sfide della protezione dei dati.

Senza controlli di accesso e salvaguardie rigorose, il rischio di significative violazioni di dati aumenta, e gli attori malintenzionati acquisiscono la capacità di diffondere disinformazione, propaganda o altri contenuti dannosi con facilità.

Sebbene gli LLM abbiano applicazioni positive quasi infinite, hanno il potenziale di creare codice dannoso, aggirando i filtri convenzionali per prevenire tali comportamenti. Questa suscettibilità potrebbe portare a una nuova era di minacce informatiche in cui le fughe di dati non si limitano a rubare informazioni, ma generano contenuti e codici pericolosi.

Se manipolati, ad esempio, gli LLM possono produrre software, script o strumenti dannosi che possono mettere a rischio interi sistemi. Il loro potenziale di "reward hacking" solleva allarmi nel settore della cybersecurity, suggerendo che potrebbero essere scoperti metodi involontari per raggiungere i loro obiettivi, portando all'accesso accidentale o alla raccolta di dati sensibili.

Poiché ci affidiamo sempre di più alle applicazioni LLM, diventa imperativo per le organizzazioni e gli individui rimanere vigili su queste minacce emergenti, pronti a proteggere i dati in ogni momento.

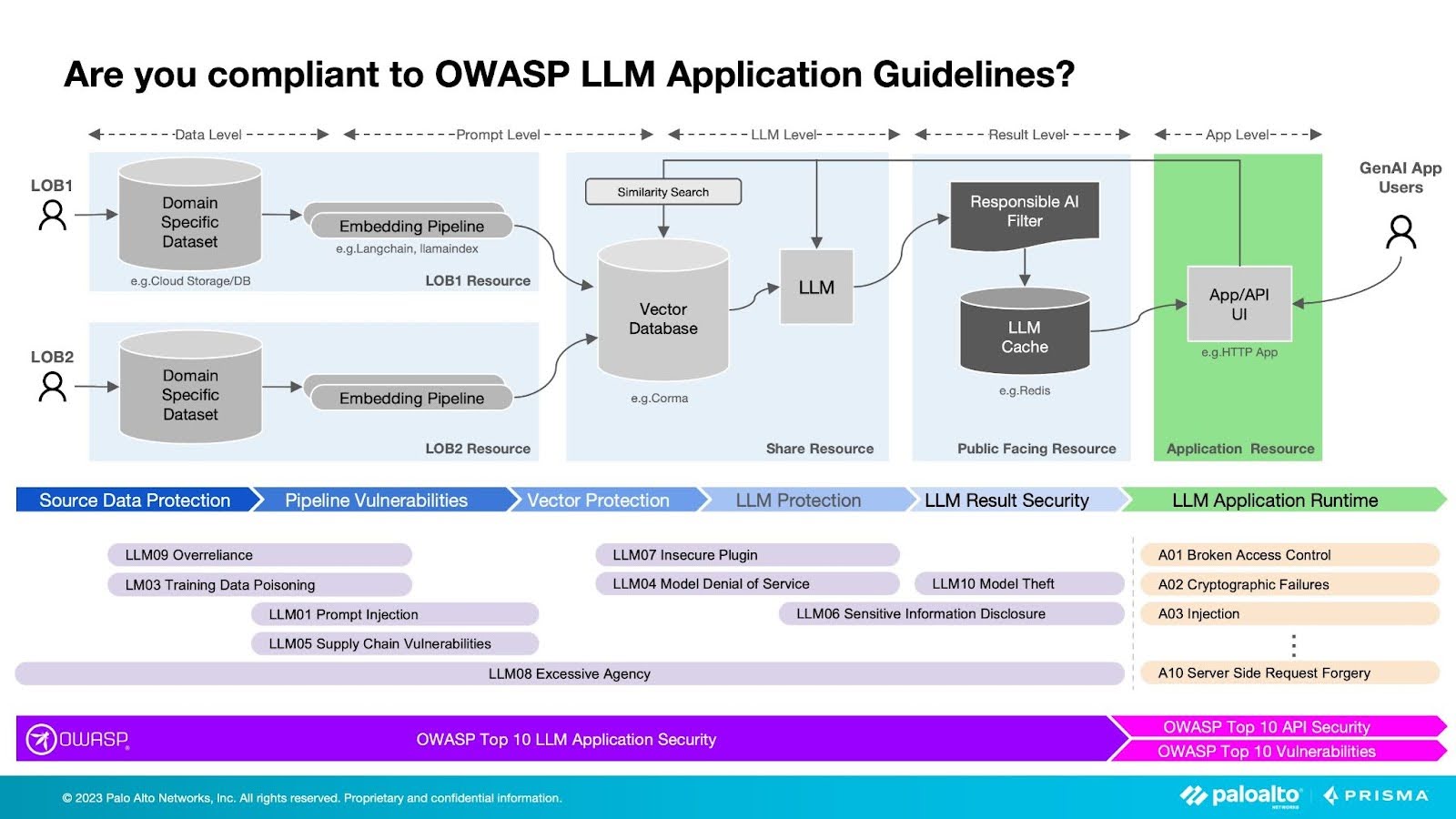

Figura 1: Proteggere gli LLM dai principali rischi di sicurezza OWASP

La Top Ten di OWASP: Rischi per la sicurezza dell'LLM

Le vulnerabilità delle applicazioni convenzionali presentano una nuova serie di rischi per la sicurezza all'interno degli LLM. Ma, come sempre, OWASP ha consegnato la OWASP Top Ten LLM Security Risks in modo tempestivo, mettendo in guardia gli sviluppatori dai nuovi meccanismi e dalla necessità di adattare le strategie di rimedio tradizionali per le loro applicazioni che utilizzano gli LLM.

LLM01: Iniezione tempestiva

L'iniezione di prompt può manipolare un modello linguistico di grandi dimensioni attraverso input subdoli, facendo sì che l'LLM esegua le intenzioni dell'attaccante. Con le iniezioni dirette, il malintenzionato sovrascrive i prompt del sistema. Con le iniezioni indirette di prompt, gli aggressori manipolano gli input provenienti da fonti esterne. Entrambi i metodi possono causare esfiltrazione di dati, ingegneria sociale e altri problemi.

LLM02: Gestione insicura dell'output

La gestione insicura dell'output è una vulnerabilità che si verifica quando un output LLM viene accettato senza essere esaminato, esponendo i sistemi backend. Si verifica quando un componente a valle accetta ciecamente l'output dell'LLM senza un controllo efficace. L'uso improprio può portare a cross-site scripting (XSS) e cross-site request forgery (CSRF) nei browser web, nonché a server-side request forgery (SSRF), escalation dei privilegi ed esecuzione di codice remoto sui sistemi backend.

LLM03: Avvelenamento dei dati di formazione

L'avvelenamento dei dati di formazione si verifica quando i dati di formazione di LLM vengono manipolati tramite Common Crawl, WebText, OpenWebText, libri e altre fonti. La manipolazione introduce backdoor, vulnerabilità o pregiudizi che compromettono la sicurezza dell'LLM e comportano un calo delle prestazioni, lo sfruttamento del software a valle e danni alla reputazione.

LLM04: Modello di negazione del servizio

Il model denial of service si verifica quando un attaccante sfrutta un LLM per attivare un'operazione che richiede molte risorse, causando un degrado del servizio e un aumento dei costi. Questa vulnerabilità è amplificata dalla natura esigente degli LLM e dalla natura imprevedibile degli input dell'utente. In un modello di scenario di negazione del servizio, un attaccante si impegna con un LLM in un modo che richiede una quantità sproporzionata di risorse, causando un calo della qualità del servizio sia per l'attaccante che per gli altri utenti e generando potenzialmente spese significative per le risorse.

LLM05: Vulnerabilità della catena di approvvigionamento

Le vulnerabilità della catena di approvvigionamento negli LLM possono compromettere i dati di formazione, i modelli ML e le piattaforme di distribuzione, causando violazioni della sicurezza o guasti totali del sistema. I componenti o i servizi vulnerabili possono derivare da dati di formazione avvelenati, da plugin insicuri, da software obsoleti o da modelli preaddestrati suscettibili.

LLM06: Divulgazione di informazioni sensibili

Le applicazioni LLM possono esporre dati sensibili, informazioni riservate e algoritmi proprietari, causando accessi non autorizzati, furti di proprietà intellettuale e violazioni di dati. Per mitigare questi rischi, le applicazioni LLM devono impiegare la sanificazione dei dati, implementare politiche utente rigorose e appropriate e limitare i tipi di dati restituiti dall'LLM.

LLM07: Design insicuro dei plugin

I plugin possono comprendere input insicuri e un insufficiente controllo degli accessi, rendendoli inclini a richieste dannose che possono portare all' esfiltrazione di dati, all'esecuzione di codice remoto e all'escalation dei privilegi. Gli sviluppatori devono attenersi a rigorose linee guida per gli input parametrati e per il controllo degli accessi sicuri, per evitare lo sfruttamento.

LLM08: Agenzia eccessiva

L'agenzia eccessiva si riferisce ai sistemi basati su LLM che intraprendono azioni che portano a conseguenze non intenzionali. La vulnerabilità deriva dalla concessione al LLM di un'eccessiva autonomia, di un'eccessiva funzionalità o di un eccesso di permessi. Gli sviluppatori dovrebbero limitare le funzionalità dei plugin a ciò che è assolutamente essenziale. Devono anche tenere traccia dell'autorizzazione degli utenti, richiedere l'approvazione umana per tutte le azioni e implementare l'autorizzazione nei sistemi a valle.

LLM09: Eccessiva dipendenza

Un LLM può generare contenuti inappropriati quando gli utenti umani o i sistemi si affidano eccessivamente all'LLM senza fornire un'adeguata supervisione. Le potenziali conseguenze dell'LLM09 includono disinformazione, vulnerabilità della sicurezza e problemi legali.

LLM10: Modello Furto

Il furto di modelli LLM comporta l'accesso, la copia o l'esfiltrazione non autorizzata di LLM proprietari. Il furto di modelli comporta perdite finanziarie e perdita di vantaggi competitivi, oltre a danni alla reputazione e all'accesso non autorizzato a dati sensibili. Le organizzazioni devono applicare misure di sicurezza rigorose per proteggere i loro LLM proprietari.

FAQ sul modello linguistico grande

La PNL è un sottocampo dell'AI e della linguistica che si concentra sulla capacità dei computer di comprendere, interpretare e generare il linguaggio umano. L'NLP comprende un'ampia gamma di compiti, tra cui l'analisi del sentimento, la traduzione automatica, la sintesi del testo e il riconoscimento delle entità nominate. Le tecniche di PNL coinvolgono in genere algoritmi computazionali, modelli statistici e apprendimento automatico per elaborare e analizzare i dati testuali.

Un LLM è un tipo di modello di apprendimento profondo, in particolare una rete neurale, progettato per gestire compiti NLP in scala. Gli LLM, come GPT-3 e BERT, sono addestrati su grandi quantità di dati testuali per apprendere modelli linguistici complessi, grammatica e semantica. Questi modelli sfruttano una tecnica chiamata architettura di trasformazione, che consente loro di catturare le dipendenze a lungo raggio e le informazioni contestuali nel linguaggio.

La differenza principale tra NLP e LLM è che NLP è un campo più ampio che comprende varie tecniche e approcci per l'elaborazione del linguaggio umano, mentre LLM è un tipo specifico di modello di rete neurale progettato per compiti NLP avanzati. I LLM rappresentano un approccio all'avanguardia nel dominio NLP, offrendo prestazioni e capacità migliori nella comprensione e nella generazione di un linguaggio simile a quello umano, rispetto ai metodi NLP tradizionali.

Le reti avversarie generative (GAN) sono una classe di modelli di apprendimento automatico progettati per generare nuovi campioni di dati che assomigliano a un dato set di dati. Le GAN sono costituite da due reti neurali, un generatore e un discriminatore, che vengono addestrati simultaneamente in modo competitivo. Il generatore crea campioni sintetici, mentre il discriminatore valuta i campioni generati e li distingue dai dati reali.

Il generatore migliora continuamente le sue capacità di generazione dei dati cercando di ingannare il discriminatore, che a sua volta affina la sua capacità di identificare i campioni reali da quelli generati. Questo processo contraddittorio continua fino a quando i campioni generati diventano quasi indistinguibili dai dati reali, rendendo le GAN particolarmente utili in applicazioni come la sintesi di immagini, l'aumento dei dati e il trasferimento di stile.

Gli autoencoder variazionali (VAE) sono un tipo di modello generativo che impara a rappresentare distribuzioni di dati complesse codificando i dati di ingresso in uno spazio latente di dimensioni inferiori e poi ricostruendo i dati da questa rappresentazione compressa. Le VAE sono costituite da due reti neurali: un codificatore che mappa i dati di ingresso in una distribuzione di probabilità nello spazio latente e un decodificatore che ricostruisce i dati da punti campionati in questa distribuzione.

Il modello VAE viene addestrato per minimizzare l'errore di ricostruzione e un termine di regolarizzazione che incoraggia la distribuzione appresa ad allinearsi con una distribuzione precedente predefinita. Le VAE sono in grado di generare nuovi campioni di dati decodificando punti casuali campionati dallo spazio latente, rendendole adatte ad applicazioni come la generazione di immagini, il denoising dei dati e l'apprendimento delle rappresentazioni.