Che cos'è l'orchestrazione dei container?

L'orchestrazione dei container è una tecnologia che automatizza la distribuzione, la gestione e la scalabilità delle applicazioni containerizzate. Semplifica le complesse attività di gestione di un gran numero di contenitori. Gli orchestratori di container, come Kubernetes, assicurano che questi container interagiscano in modo efficiente tra diversi server e ambienti. Gli orchestratori forniscono un quadro per gestire i cicli di vita dei container, facilitare la scoperta dei servizi e mantenere l'alta disponibilità. Per le architetture microservizi, dove le applicazioni cloud-native sono costituite da numerosi componenti interdipendenti, questo framework è fondamentale.

Sfruttando l'orchestrazione dei container, i team di DevOps possono ottimizzare il provisioning, l'allocazione delle risorse e la scalabilità, consentendo loro di sfruttare appieno il potenziale della containerizzazione e di allinearlo agli obiettivi aziendali.

Spiegazione dell'orchestrazione dei container

L'orchestrazione dei container automatizza la distribuzione, la gestione e la scalabilità delle applicazioni containerizzate. Le aziende utilizzano gli orchestratori per controllare e coordinare un numero massiccio di container, assicurandosi che interagiscano in modo efficiente tra i diversi server.

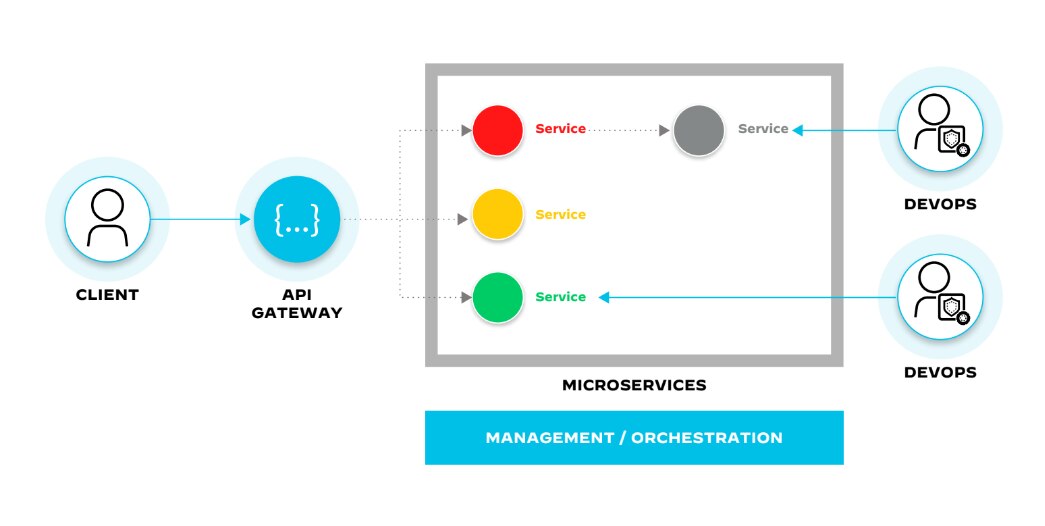

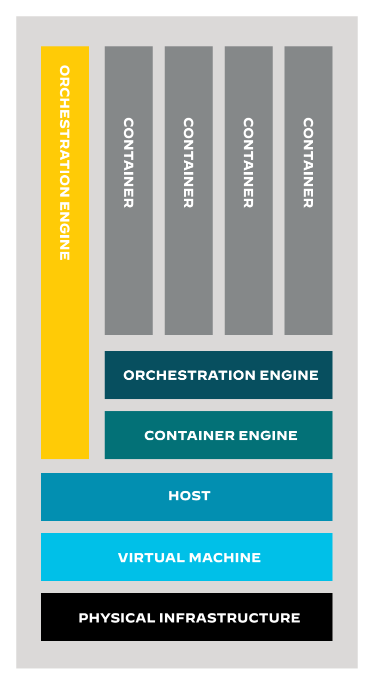

Figura 1: Il livello di orchestrazione distribuisce nuove versioni di microservizi, mette in scala i microservizi per soddisfare la domanda e monitora i microservizi per le prestazioni e la salute.

Gli orchestratori come Kubernetes gestiscono i cicli di vita, facilitano la scoperta dei servizi e mantengono l'alta disponibilità. Consentono ai container di funzionare di concerto, il che è essenziale per le architetture a microservizi, dove le applicazioni native del cloud sono costituite da numerosi componenti interdipendenti.

Il mercato dell'orchestrazione dei container sta infatti tenendo il passo con l'adozione di architetture di microservizi, applicazioni cloud-native e containerizzazione. Calcolato a 745,72 milioni di dollari nel 2022 - con un aumento del 26% in un periodo di cinque anni - le dimensioni del mercato continuano a salire e si prevede che raggiungeranno 1084,79 miliardi di dollari entro il 2029.

Strumenti di orchestrazione

Gli strumenti di orchestrazione forniscono un quadro per automatizzare i carichi di lavoro dei container, consentendo ai team DevOps di gestire i cicli di vita dei loro container. Questi sistemi, o motori di orchestrazione, facilitano le funzionalità di rete avanzate, semplificando il provisioning di container e microservizi e regolando le risorse per soddisfare la domanda. Con gli orchestratori, i team DevOps possono sfruttare tutto il potenziale della containerizzazione, allineandola agli obiettivi aziendali.

Motori di orchestrazione dei container più diffusi

- Kubernetes® (K8s)

- Ranchero

- SUSE Rancher

- Servizi Amazon Elastic Kubernetes (EKS)

- Servizi Kubernetes di Azure (AKS)

- Google Kubernetes Engine (GKE) / Anthos

- Red Hat OpenShift Container Platform (OCP)

- Mesos

- Piattaforma Cisco Container (CCP)

- Oracle Container Engine per Kubernetes (OKE)

- Ericsson Container Cloud (ECC)

- Docker Swarm

- HashiCorp Nomad

Il vantaggio dei motori di orchestrazione deriva dal modello dichiarativo che in genere utilizzano, che combina efficacemente i vantaggi di infrastruttura come servizio (IaaS) e piattaforma come servizio (PaaS).

- L'IaaS offre il controllo granulare e l'automazione che consente agli sviluppatori di gestire l'infrastruttura sottostante, come i server, lo storage e la rete. Questo offre agli sviluppatori la flessibilità di personalizzare le distribuzioni per soddisfare esigenze specifiche.

- La PaaS offre un livello di astrazione superiore che consente agli sviluppatori di concentrarsi sulle loro applicazioni senza doversi preoccupare dell'infrastruttura sottostante. Il PaaS rende più facile per gli ingegneri distribuire e gestire le loro applicazioni, ma fornisce anche un minor controllo sull'infrastruttura.

Attingendo dal meglio di entrambi i mondi, gli orchestratori offrono agli sviluppatori potenza e flessibilità, nonché un'esperienza operativa coerente in tutti gli ambienti, dalle macchine fisiche e dai data center locali alle distribuzioni virtuali e ai sistemi basati su cloud.

Le caratteristiche principali dei principali motori di orchestrazione includono la programmazione, la gestione delle risorse, la scoperta dei servizi, i controlli di salute, l'autoscaling e la gestione degli aggiornamenti e degli upgrade.

Componenti chiave degli orchestratori

La terminologia dei componenti di orchestrazione dei container varia tra gli strumenti attualmente sul mercato. I concetti e le funzionalità sottostanti, tuttavia, rimangono relativamente coerenti. La Tabella 3 fornisce una panoramica comparativa dei componenti principali con la terminologia corrispondente per gli orchestratori di container più diffusi. Per i nostri scopi, per introdurre un senso della meccanica dell'orchestrazione, useremo i termini di Kubernetes.

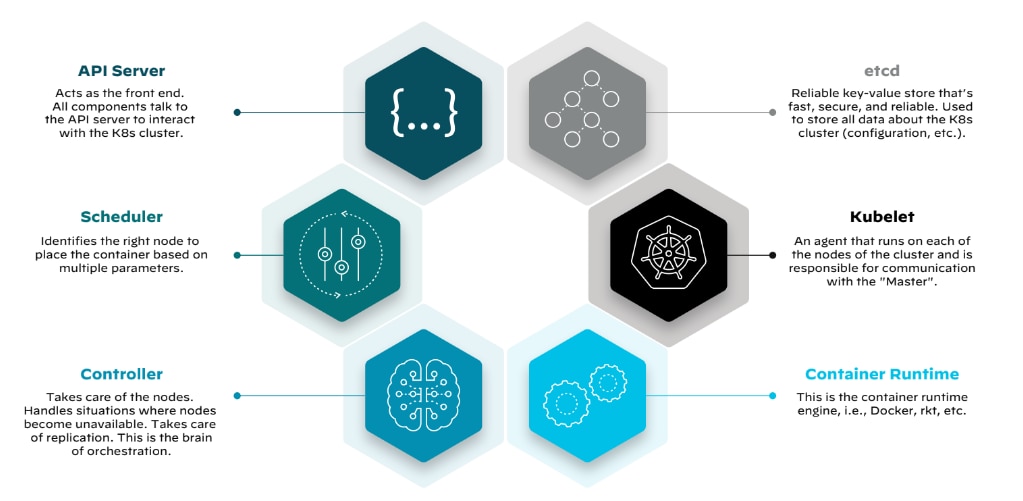

Figura 2: Panoramica del componente di orchestrazione dei container

I motori di orchestrazione come Kubernetes sono complessi, costituiti da diversi componenti tecnologici chiave che lavorano all'unisono per gestire il ciclo di vita dei container. Comprendendo i componenti chiave, si capisce come utilizzare al meglio le tecnologie di containerizzazione.

Il piano di controllo

Il cuore di Kubernetes è il suo piano di controllo, il centro di comando per la programmazione e la gestione del ciclo di vita delle applicazioni. Il piano di controllo espone l'API di Kubernetes, orchestra le distribuzioni e dirige la comunicazione in tutto il sistema. Inoltre, monitora la salute dei container e gestisce il cluster, assicurando che le immagini container siano prontamente disponibili da un registro per la distribuzione.

Il piano di controllo di Kubernetes comprende diversi componenti: etcd, il server API, lo scheduler e il controller-manager.

Etcd

L'archivio dati etcd, sviluppato da CoreOS e successivamente acquisito da Red Hat, è un archivio distribuito chiave-valore che contiene i dati di configurazione del cluster. Informa le azioni dell'orchestratore per mantenere lo stato dell'applicazione desiderato, come definito da una politica dichiarativa. Questa politica delinea l'ambiente ottimale per un'applicazione, guidando l'orchestratore nella gestione di proprietà come il numero di istanze, le esigenze di archiviazione e l'allocazione delle risorse.

Server API

Il server API di Kubernetes svolge un ruolo fondamentale, esponendo le funzionalità del cluster tramite un'interfaccia RESTful. Elabora le richieste, le convalida e aggiorna lo stato del cluster in base alle istruzioni ricevute. Questo meccanismo consente la configurazione e la gestione dinamica dei carichi di lavoro e delle risorse.

Programmatore

Lo scheduler di Kubernetes assegna i carichi di lavoro ai nodi worker in base alla disponibilità delle risorse e ad altri vincoli, come la qualità del servizio e le regole di affinità. Lo scheduler assicura che la distribuzione dei carichi di lavoro rimanga ottimizzata per lo stato attuale del cluster e la configurazione delle risorse.

Controllore-Manager

Il controller-manager mantiene lo stato desiderato delle applicazioni. Funziona attraverso i controllori, cicli di controllo che monitorano lo stato condiviso del cluster ed effettuano regolazioni per allineare lo stato attuale con lo stato desiderato. Questi controllori assicurano la stabilità dei nodi e dei pod, rispondendo alle modifiche della salute del cluster per mantenere la coerenza operativa.

| Orchestratore di container | Componenti del piano di controllo | Componenti del nodo lavoratore | Unità di distribuzione | Servizio |

|---|---|---|---|---|

| Kubernetes | Server API, Scheduler, Controller Manager, eccd | kubelet | Pod | Servizio |

| Docker Swarm | Manager | Lavoratore | Servizio | Pila |

| Nomade | Server | Agente | Lavoro | Assegnazione |

| Mesos | Maestro | Agente | Compito | Lavoro |

| OpenShift | Console, Controller Manager, etcd | Nodo | Pod | Servizio |

| Amazon Elastic Container Service (ECS) | Controllore del cluster | Istanze EC2 | Compito | Servizio |

| Google Kubernetes Engine (GKE) | Piano di controllo | Nodi | Pod | Servizio |

| Servizio Azure Kubernetes (AKS) | Piano di controllo | Nodi | Pod | Servizio |

Tabella 1: Componenti comuni a diversi motori di orchestrazione.

Orchestrazione e infrastruttura immutabile

A differenza dei server e delle macchine virtuali tradizionali, il paradigma immutabile dei container e della loro infrastruttura rende inesistenti le modifiche successive alla distribuzione. Invece, gli aggiornamenti o le correzioni vengono applicati distribuendo nuovi container o server da un'immagine comune con le modifiche necessarie.

La programmabilità intrinseca dell'infrastruttura immutabile consente l'automazione. L'infrastruttura come codice (IaC) è un segno distintivo dell'infrastruttura moderna, che consente alle applicazioni di fornire, configurare e gestire in modo programmatico l'infrastruttura richiesta. La potenza combinata dell'orchestrazione dei container, dell'infrastruttura immutabile e dell'automazione guidata da IaC offre una flessibilità e una scalabilità senza pari.

L'orchestrazione dei container e la pipeline

Spinta dai due motori della containerizzazione e di DevOps, l'orchestrazione dei container unisce velocità e scalabilità per sostenere la pipeline di produzione dinamica ed esigente di oggi.

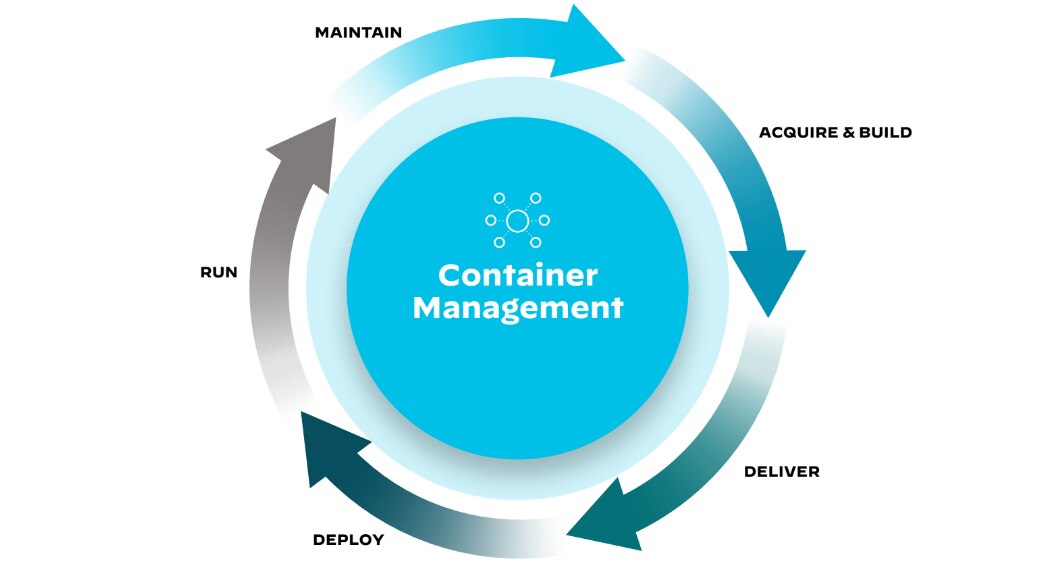

Figura 3: Pipeline CI/CD ciclo di vita di sviluppo dell'applicazione

Fase di acquisizione e costruzione della pipeline

Nella fase di acquisizione e costruzione, gli sviluppatori estraggono il codice dai repository di controllo della versione, avviando il processo di costruzione. Gli strumenti automatizzati compilano il codice sorgente in artefatti binari pronti per la distribuzione con uno strumento come Docker o BuildKit. Una volta costruita l'immagine container, viene archiviata in un registro come Docker Hub o Google Artifact Registry.

La fase di acquisizione e costruzione promuove la costruzione coerente dell'applicazione, con script che gestiscono le dipendenze ed eseguono test preliminari. Il risultato è una build affidabile che, una volta integrata con il ramo principale, attiva ulteriori processi automatizzati.

Fase di esecuzione

Al termine della fase di compilazione, la pipeline esegue il codice in un ambiente controllato. L'esecuzione dell'immagine container in un ambiente di staging può essere effettuata utilizzando uno strumento di orchestrazione di container come Kubernetes. Questa fase cruciale prevede che il team conduca una serie di test automatizzati per convalidare la funzionalità dell'applicazione. Gli sviluppatori cercano e risolvono attivamente i bug, assicurando la progressione di solo codice di alta qualità attraverso la pipeline.

Fase di consegna

Nella fase di consegna della pipeline CI/CD, i team automatizzano il percorso del nuovo codice dal repository alla disponibilità per la produzione. Ogni commit avvia una sequenza di rigorosi test automatizzati e controlli di qualità, assicurando che solo il codice ben collaudato raggiunga l'ambiente di staging. Qui il software viene sottoposto a ulteriori convalide, spesso rivolte al cliente. Il processo racchiude la promozione della costruzione attraverso gli ambienti, ognuno dei quali serve come terreno di prova per la stabilità e le prestazioni. L'impegno del team nella fase di consegna assicura che il software incarni il meglio degli sforzi di sviluppo attuali.

Fase di distribuzione.

Nella fase di distribuzione, l'applicazione raggiunge il suo momento cruciale, quando i team la distribuiscono all'ambiente di produzione. Gli strumenti di orchestrazione dei container, come Kubernetes, assumono il controllo, scalando l'applicazione e aggiornandola con tempi di inattività minimi. I team hanno a disposizione meccanismi di rollback, che consentono di tornare alle versioni precedenti se emergono problemi. A questo punto, l'applicazione diventa operativa, servendo gli utenti previsti e soddisfacendo il suo scopo nell'ecosistema digitale.

Mantenere la fase

Dopo la distribuzione, il team passa alla manutenzione attiva dell'applicazione. Impiegano una soluzione runtime per monitorare continuamente le prestazioni, registrare gli errori e raccogliere il feedback degli utenti, tutti elementi che guidano i miglioramenti futuri, nonché la sicurezza container.

Mentre gli sviluppatori perfezionano l'applicazione, applicano le patch di sicurezza e lanciano nuove funzionalità, la fase di manutenzione sottolinea la natura iterativa dello sviluppo di applicazioni moderne. Invariabilmente, il prodotto continua ad evolversi per soddisfare le richieste degli utenti e integrare gli ultimi progressi tecnologici.

Vantaggi dell'orchestrazione dei container

L'orchestrazione dei container offre una serie di vantaggi che si allineano agli obiettivi di DevOps, migliorando in ultima analisi l'efficienza operativa e riducendo le spese generali negli ambienti cloud.

Migliora la scalabilità

Le piattaforme di orchestrazione dei container consentono alle aziende di scalare le applicazioni containerizzate in risposta alle fluttuazioni della domanda, senza l'intervento umano o il tentativo di prevedere il carico delle applicazioni. Le funzionalità di bin packaging e di autoscaling dell'orchestratore, abbinate all'infrastruttura del cloud pubblico come codice, allocano dinamicamente le risorse, garantendo prestazioni ottimali durante i picchi di carico.

Facilita la resilienza

Distribuendo le istanze dei container su più host, gli strumenti di orchestrazione rafforzano la resilienza delle applicazioni. Rilevano i guasti e riavviano automaticamente i contenitori, riducendo al minimo i tempi di inattività e mantenendo la continuità del servizio.

Promuove l'efficienza

I motori di orchestrazione adattano le risorse esattamente a ciò che un'applicazione richiede in vari scenari d'uso, evitando un overprovisioning dilagante o richiedendo alle organizzazioni di progettare e pianificare un elevato utilizzo dell'acqua. Questa efficienza riduce i costi dell'infrastruttura e massimizza il ritorno sull'investimento.

Semplifica la gestione

Gli orchestratori di container forniscono un'interfaccia unificata per gestire i cluster di container, astraendo le attività complesse e riducendo il carico operativo. I team possono distribuire gli aggiornamenti, monitorare lo stato di salute e applicare le politiche con un intervento manuale minimo.

Migliora la sicurezza

L'orchestrazione dei container migliora la sicurezza automatizzando la distribuzione di patch e aggiornamenti di sicurezza. Applica politiche di sicurezza coerenti all'intera flotta di container, riducendo il rischio di vulnerabilità.

Abilita la portabilità

L'orchestrazione assicura che le applicazioni containerizzate rimangano agnostiche rispetto all'infrastruttura sottostante, facilitando la portabilità tra diversi ambienti cloud e data center locali.

Accelera i cicli di distribuzione.

Automatizzando i processi di distribuzione, gli strumenti di orchestrazione accorciano i tempi dallo sviluppo alla produzione, consentendo un'iterazione rapida e un time to market più veloce per le nuove funzionalità.

Supporta le pratiche DevOps.

Integrandosi con le pipeline CI/CD e migliorando l'agilità dello sviluppo software, l'orchestrazione dei container favorisce la collaborazione tra i team di sviluppo e operativi. Funzionalità come il monitoraggio dello stato di salute e l'auto-guarigione consentono ai team di ridurre l'assistenza e la risoluzione dei problemi del sistema, ottimizzando la produttività DevOps.

L'ecosistema dei container

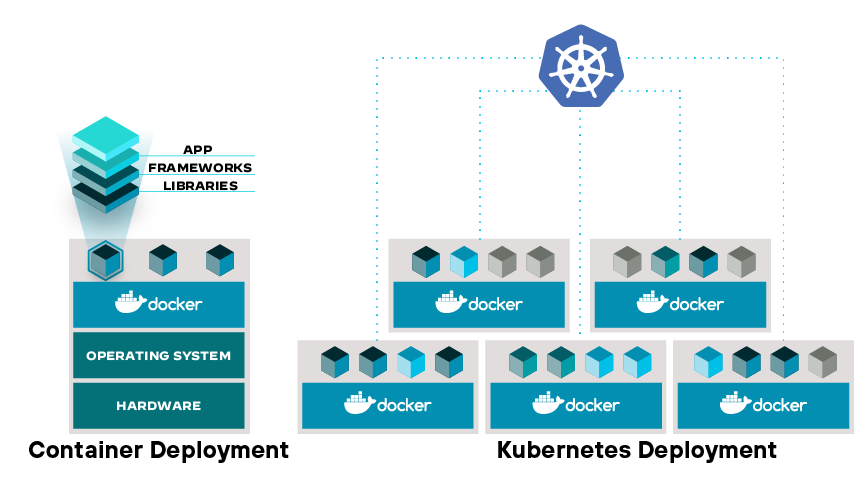

Semplicemente, l'ecosistema dei container rappresenta un cambiamento significativo nello sviluppo e nella distribuzione delle applicazioni. Comprendendo una serie di componenti - dai motori di runtime alle piattaforme di orchestrazione, ai registri e agli strumenti di sicurezza - offre alle aziende l'efficienza fondamentale richiesta dal frenetico panorama digitale di oggi.

Naturalmente, il cuore dell'ecosistema è la sinergia tra il motore di container e il motore di orchestrazione. Insieme, queste tecnologie guidano le applicazioni containerizzate attraverso le complesse fasi del loro ciclo di vita.

Il motore del container crea e pacchettizza i singoli container, mentre il motore dell'orchestratore gestisce e orchestra più container in un'infrastruttura distribuita.

Durante lo sviluppo, il motore di container facilita la prototipazione e il test rapidi, consentendo agli sviluppatori di iterare in modo rapido ed efficiente. Man mano che l'applicazione matura, l'orchestratore la trasferisce in produzione, fornendo una base robusta e scalabile per gestire i carichi di lavoro del mondo reale.

Figura 4: Docker e Kubernetes che rappresentano le dinamiche dei motori di container e di orchestrazione

Implicazioni strategiche per i dirigenti aziendali

Agilità e velocità nella distribuzione del software.

L'ecosistema dei container accelera la distribuzione delle applicazioni. Incapsulando le applicazioni nei container, le organizzazioni possono passare rapidamente dallo sviluppo alla produzione, indipendentemente dall'ambiente sottostante. Questa agilità è fondamentale per le organizzazioni che devono adattarsi rapidamente ai cambiamenti del mercato o alle richieste degli utenti.

Maggiore efficienza e ottimizzazione delle risorse.

Offrendo un'alternativa alle macchine virtuali tradizionali, i container condividono il kernel OS sottostante e consumano meno risorse. Questa efficienza si traduce in una riduzione dei costi operativi e in un migliore utilizzo delle risorse informatiche, un vantaggio fondamentale per le aziende che gestiscono applicazioni su larga scala.

Scalabilità e flessibilità

Vitali per le imprese digitali che sperimentano una domanda fluttuante, gli orchestratori all'interno dell'ecosistema dei container consentono alle aziende di scalare le loro applicazioni senza compromettere le prestazioni. L'ecosistema dei container nel suo complesso perfeziona le precedenti capacità di scalabilità e disponibilità di risorse.

Coerenza e portabilità tra gli ambienti.

L'ecosistema dei container garantisce coerenza e portabilità. Le applicazioni confezionate in container possono essere eseguite in modo uniforme e affidabile in diversi ambienti computing, dai data center locali ai cloud pubblici.

Figura 5: Anatomia dell'ambiente container ospitato

Prepararsi per un futuro guidato dai container

Il futuro indica un mondo digitale in cui la maggior parte, se non tutte, le applicazioni vengono eseguite su container. Per i dirigenti, comprendere la sinergia dietro l'ecosistema dei container offre un vantaggio strategico. Un punto di vista informato può consentirle di anticipare e soddisfare efficacemente le esigenze in evoluzione dello sviluppo software moderno - e con un ROI ottimale.